色々とイベントがある合間にRyzen 7 8700Gを仕入れておりました。

まぁ,個人的に最近のホットな話題であり,世間的には世界初のNPU搭載デスクトップCPUとして一部マニアの注目を集めております。

AMD Ryzen™ AI - Windows Laptops with AI Built In

前世代のAPU(5700G)でのAI性能は以前から試しており今回はこの辺基準で8700Gを評価していきます。

比較対象としてMacのCoreMLも簡単にテストしてあります。こちらもNPU搭載機です。

CoreMLの実験(dGPU無い勢) - 48's diary

NPUって何かって話はこの辺でしてありますが,今年はAI関連ソフトウェアが一気に普及帯のPCでも動くようになっていくと思われます。(実際は2,3年はかかると思います)

で,Ryzen 7 8700Gですが出た直後に有無を言わさず発注したので5万円台の後半でした。すぐに前半もしくは4万円台に落ちると思います。

ソケットはAM5ですのでAMDの対応マザーは多くありますが気を付けないといけないのはBIOSのアップデートを行わないと動作しないものがマーケットに多くあります。今後出荷されるようなマザーボードは出荷時に対応されると思いますが,私がそうであるように他のCPUをもってBIOS更新を行う必要がありました。

起動してしまえばなんてことは無い普通のAPU機です。リテールファンで問題なく冷却可能な省電力(65W)でGPU内蔵のCPUとして申し分ありません。うっかり500Wの電源で組んでしまいましたが,AsrockのDesk miniとかで組むのが良い感じになるでしょう。

で,上記実験と比較するためにDirectMLでテストを行っています。

現状雑感ですが,Macや5700Gの1.5~2倍近いパフォーマンスと言って良いでしょう。

これは他のゲーミングベンチマークを取っているところでも似たような評価です。

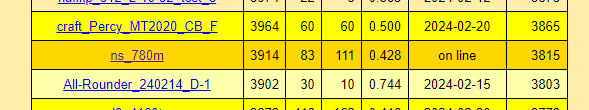

内蔵GPUはRadeon 780Mと呼称されているのでnibanshiboriを同名でfloodgateに放り込んでみました。

レートは3800台ですので以前GTX1060などで記録した付近です。パフォーマンス的にはGTX1060を超えているので安定するともう少し上かもしれません。もう驚く必要はないですが他のモデルと精度が違うのは明白ですね。

特筆すべき一局があったので記録しておきます。GTOはレート4500 overですので相当なスペックのPCかと思います。二番絞りは探索ノードが少ないときに後手番で振り飛車しがちなのですが,これも後手四間飛車です。で,勝ってしまっています。

GTO vs. ns_780m (2024-02-15 16:00)

これ500nps程度なので20秒使う手がありますが,そこで精々10000ノードの探索なのです。

この辺はさておき現状のDirectMLは恐らくRyzen AI未対応ですので,今後の対応でどこまで向上するかの基準となると考えています。CUDA界隈でも新しいハードウェアが出てからソフトウェア対応する間の過渡期で結構なパフォーマンス向上がありますので,その辺を期待しております。特にRyzen AIに限らずNPU対応は今年の多くのソフトウェアの課題となると思います。楽しみですね。

---

追記:

floodgateにおいて200戦近く行い最終レートが3900付近でした。

dGPU無しでの到達レートとしては最高レベルかと思います。

加えてその間熱暴走など皆無ですので8700GはAI用途でも連続高負荷で問題ないと判断します。

この辺りから比べて随分とレートを上げました。